ChatGPT: vous pouvez désormais refuser que l'IA s'entraine avec vos données

OpenAI propose aux utilisateurs de ChatGPT davantage d’options concernant la sécurité de leurs données personnelles, en modifiant leurs paramètres de compte, a annoncé la startup à l'origine du chatbot dans un article de blog ce mardi 26 avril.

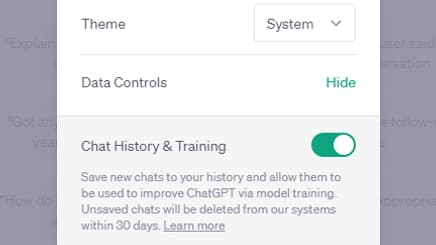

Il est désormais possible de désactiver l’historique de conversation, qui ne sera plus stocké sur le côté gauche du chat, ni utilisé par OpenAi pour entraîner son modèle de langage.

Les messages seront cependant conservés pendant 30 jours, afin de repérer les comportements abusifs, précise l’entreprise basée à San Francisco. Et à moins de désactiver l’option, les conversations des utilisateurs seront utilisées par défaut pour améliorer l’IA générative.

Inquiétudes sur les données

Pour mettre au point une IA conversationnelle, un ensemble de données d’entraînement de milliards de mots a été nécessaire, pour finalement parvenir à générer des réponses cohérentes et structurées. Jusqu’ici, la version en ligne de ChatGPT (GPT-3.5 ou GPT-4) continuait de s’entraîner sur l’ensemble de ses discussions avec ses utilisateurs — 186 millions rien que sur le mois de mars —, affinant sa précision au fur et à mesure des échanges.

"Nous souhaitons aller vers la direction où les gens qui utilisent nos produits peuvent décider comment leurs données sont utilisées — si elles sont utilisées pour entraîner [nos modèles] ou non", a assuré le directeur en charge des nouvelles technologies à OpenAI Mira Murati, lors d’une présentation la veille de l’annonce.

En France, trois plaintes visent déjà ChatGPT en lien avec son traitement des données personnelles.