ChatGPT: Microsoft propose de choisir la personnalité du chatbot de Bing

Il est désormais possible de choisir la personnalité à attribuer au chatbot de Bing. Microsoft a ainsi ajouté une fonctionnalité au moteur de recherche, qui permet de modifier le ton des réponses données par le chatbot Bing AI, conçu sur le modèle de ChatGPT.

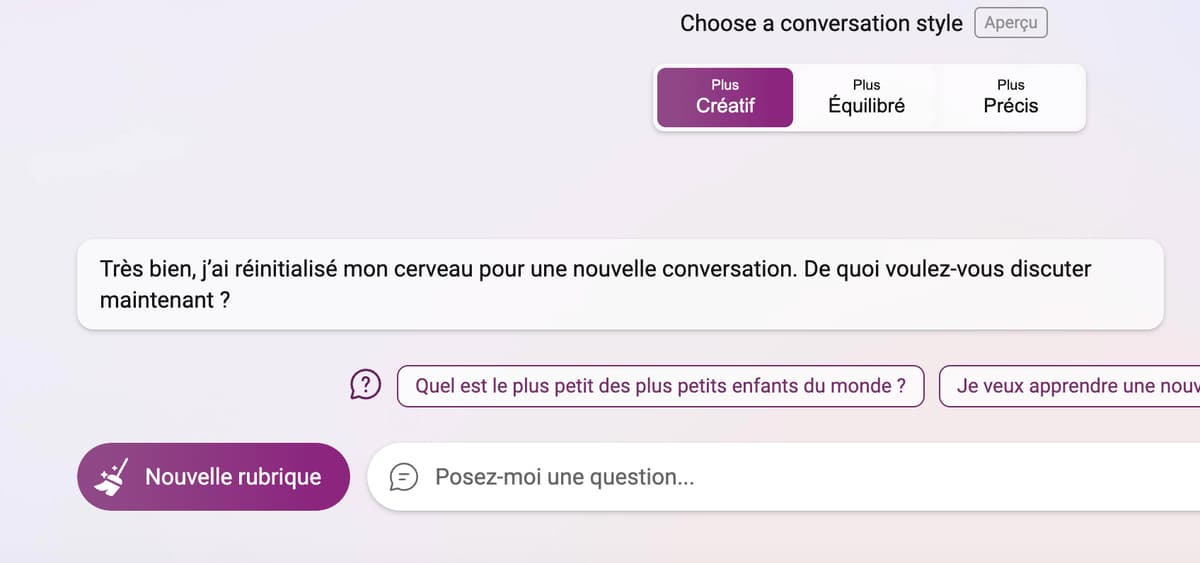

Trois types de réponses sont désormais possibles : un mode "créatif" qui comprend des réponses "originales et imaginatives", un mode "précis" qui privilégie des réponses plus factuelles et concises, et un mode "équilibré", défini par défaut, censé donner des réponses entre la précision et la créativité.

Selon The Verge, ces nouveaux modes sont actuellement déployés pour tous les utilisateurs de Bing AI, et seraient déjà visibles par environ 90% d'entre eux. Ils sont censés permettre d'éviter les dérapages du logiciel conversationnel, qui multipliait les remarques déplacées et insultes vis-à-vis des utilisateurs.

Une mise à jour pour réduire les non-réponses

Pour limiter les risques, Microsoft avait dans un premier temps décidé de limiter les conversations à cinq questions sur un même sujet. Une fois les cinq questions posées, le système se remettait à zéro et entamait une nouvelle conversation, “oubliant” ce qui avait été dit précédemment.

L'entreprise américaine avait ensuite totalement aseptisé le chatbot de Bing. Dès qu'une réponse sortait d'un cadre très consensuel des vacances en Italie ou des meilleures recettes de tacos, l'intelligence finissait inexorablement par répondre par la phrase: "Je suis désolé, mais je préfère ne pas continuer cette conversation".

Une mise à jour plus tôt cette semaine aurait résolu la plupart des problèmes de non-réponse, d'après The Verge. Elle aurait permis une "réduction significative des cas où Bing refuse de répondre sans raison apparente", selon Mikhail Parakhin, responsable des services Web chez Microsoft, cité par le site américain.