On a tenté de résumer le travail des prix Nobel de physique qui ont transformé l'intelligence artificielle

Les réseaux de neurones... Le terme est aujourd'hui largement employé lorsqu’on parle d'intelligence artificielle. Car depuis plusieurs années, le monde de l'IA bénéficie de cette innovation, ChatGPT est un exemple parmi tant d’autres.

Les deux chercheurs à l’origine de ce modèle viennent de recevoir le prestigieux prix Nobel de Physique 2024. Leurs travaux ont ainsi bouleversé le secteur de la tech lorsqu’on a découvert leur potentiel et qu’on a pu le déployer à une grande échelle.

Tech&Co a tenté de résumer ces fameux réseaux de neurones qui, après tant d’années, se sont vus récompensés par l’Académie royale des Sciences de Suède. En creux, le fameux "machine learning".

John Hopfield, le pionnier

Le premier à contribuer à cette avancée capitale en informatique est à la base physicien. John Hopfield s’est inspiré des synapses (cellules qui font passer les informations dans le cerveau) et d’une propriété des atomes, le spin, pour créer le premier réseau de neurones.

Son fonctionnement est similaire à la répartition dans deux équipes de foot.

En tant que coach, on souhaite organiser un match: on constitue donc deux équipes, rouge et bleu. Six joueurs sont répartis aléatoirement dans ces deux équipes, même si le nombre de joueurs est différent chez les bleus et chez les rouges.

Mais la composition des équipes est à revoir, cette répartition aléatoire crée des disputes entre joueurs. On a complètement oublié que les dix joueurs appartiennent à deux groupes de copains: au sein du même groupe les joueurs s’apprécient mais ils détestent tout joueur venant de l’autre groupe.

Ces relations entre joueurs tissent un réseau. Pour avoir deux équipes optimales, on va éviter de mettre les joueurs qui se détestent ensemble et on va essayer de regrouper les joueurs qui s’entendent bien dans la même équipe.

Faire s'entendre entre eux des neurones

Comment procéder? On va étudier cas par cas les joueurs, ses relations avec les autres joueurs et les couleurs d’équipe des joueurs comparés. On commence au hasard avec le joueur 1, attribué au départ à l'équipe bleue. Si la majorité des gens qu’il déteste sont dans l’équipe bleue et beaucoup de ses amis sont dans l’équipe rouge, on le bascule vers l’équipe rouge.

Puis au tour du joueur 2, attribué au départ à l'équipe rouge. Si la majorité des gens qu’il déteste sont dans l’équipe bleue et beaucoup de ses amis sont dans l’équipe rouge y compris le joueur 1 qu’on vient de changer, on le laisse dans l’équipe rouge. Puis vient le joueur 3 …

À force de répéter ces opérations, on arrive à un stade où les joueurs n’ont plus besoin de changer de couleur. On retombe au bout d’un moment sur deux équipes qui correspondent aux deux groupes de copains.

On opère de la même manière dans le réseau de neurones de Hopfield. Il suffit de remplacer les joueurs par des neurones, les couleurs d’équipe par 0 ou 1. Un modèle de départ (les deux groupes de copains) va générer notre réseau qui détermine les relations entre chaque neurone.

Comme pour nos joueurs, on va regarder les neurones un par un et les relations qu’ils entretiennent avec les autres. Après de très nombreuses itérations, les valeurs des neurones se stabilisent, on retrouve le modèle de départ.

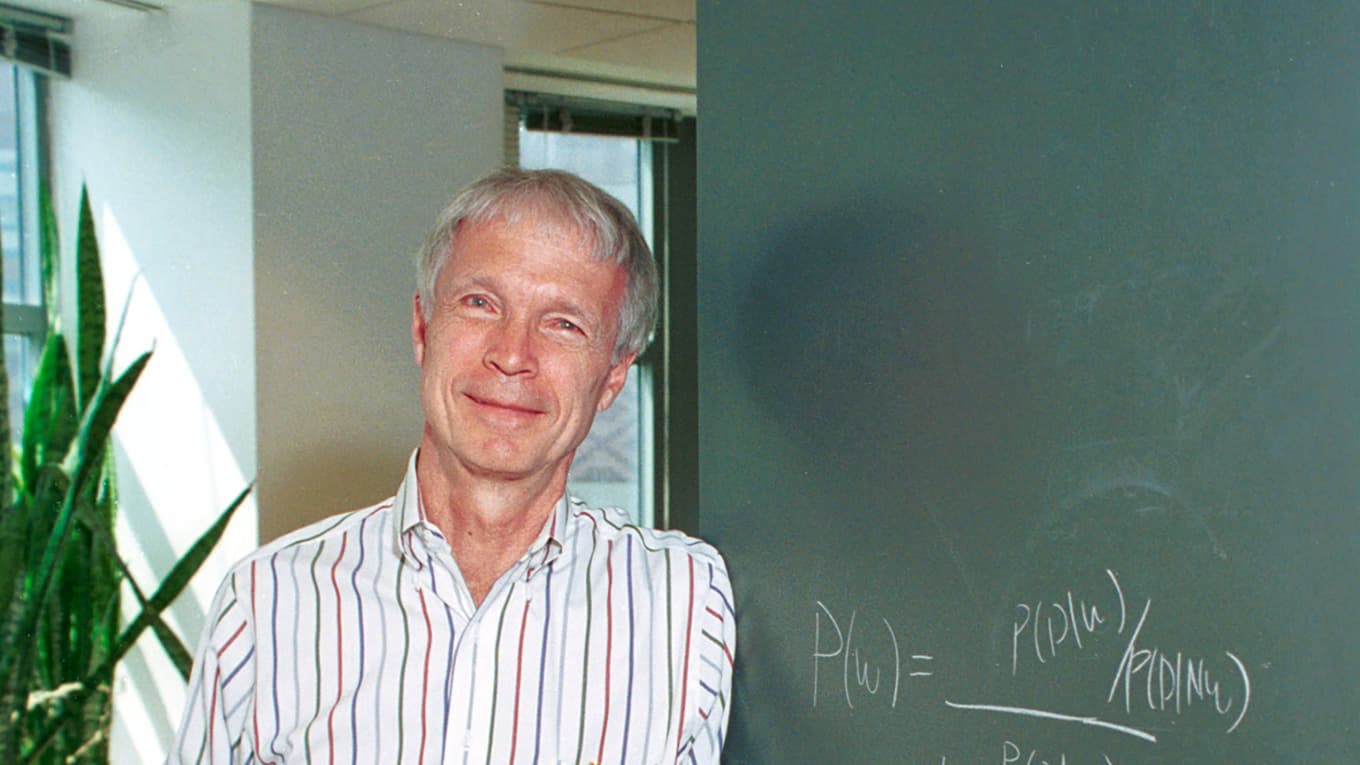

Ces travaux menés par John Hopfield dans les années 1980 inspireront notre deuxième protagoniste. Geoffrey Hinton, depuis longtemps considéré comme un des pères de l'IA, fera évoluer ce système en lui offrant la capacité d’apprendre.

Geoffrey Hinton et l’apprentissage automatique

On remet notre casquette de coach puisqu’on veut constituer deux nouvelles équipes. Sauf que cette fois, on met notre expérience à contribution. Bleu ou rouge, il va falloir se baser sur les derniers matchs pour répartir les joueurs dans les équipes.

Exemple: on sait d’expérience que si on met les joueurs de deux numéros successifs dans la même équipe, impossible de mettre le joueur du numéro d’après avec ces deux-là. C’est un "pattern" (un "modèle").

Par exemple, si dans notre distribution aléatoire de couleur, on retrouve les joueurs 1, 2 et 3 dans l’équipe rouge, on changera le joueur 3 pour l’équipe bleu. Le réseau a reconnu le pattern.

C’est le principe des travaux de Hinton qui a entraîné sa machine à reconnaître certains patterns. Ces patterns, gardés en mémoire, vont grandement influencer la valeur de chaque neurone.

En multipliant les entraînements, la machine sera en mesure d’apprendre de nouveaux patterns et reconnaîtra plus facilement ceux qu’il a déjà en mémoire. On entend alors parler d’apprentissage automatique (ou en anglais machine learning).

Un potentiel révélé bien après sa découverte

Ces algorithmes sont aujourd’hui la base de l’intelligence artificielle. Certaines IA ont subi un très grand nombre d'entraînements et ont emmagasiné pléthore de ces patterns. C’est par exemple ce que l’on fait avec les Captchas, ces tests en ligne pour prouver qu’on n'est pas un robot. Sur une photo, on nous demande par exemple de cocher les cases où il y a un vélo. On apprend ici à une IA à reconnaître un pattern de vélo dans une image.

Également appliqué à ChatGPT, le machine learning permet de prédire quel mot vient après le précédent. C'est le principe des IA génératives qui, tels des pérroquets, se contentent de déterminer quel mot est le plus apte à suivre le premier.